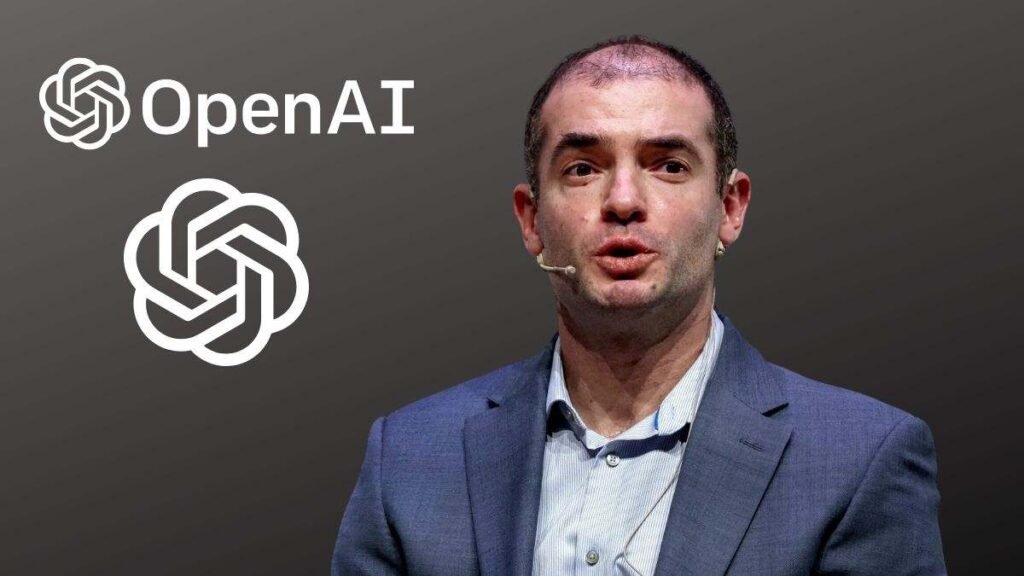

Ilya Sutskever es un destacado científico de la computación, cofundador y exjefe científico de OpenAI, clave en el desarrollo del aprendizaje profundo (deep learning) y modelos generativos como GPT. Nacido en Rusia y formado en Canadá, es una figura central en la IA moderna, con un enfoque cauteloso hacia la seguridad de la inteligencia artificial general (AGI). Recientemente, fundó Safe Superintelligence Inc. (SSI) tras salir de OpenA

Principales hitos en su carrera:

- Formación y orígenes: Estudió en la Universidad de Toronto bajo la tutela de Geoffrey Hinton, pionero del aprendizaje profundo.

- Investigación clave: Co-inventó AlexNet, una red neuronal convolucional que revolucionó el reconocimiento de imágenes, y trabajó en Google Brain.

- Fundación de OpenAI: En 2015, se convirtió en cofundador y jefe científico de OpenAI, desempeñando un papel decisivo en el desarrollo de los modelos GPT.

- Conflicto y Salida: En noviembre de 2023, formó parte del consejo que destituyó temporalmente a Sam Altman, mostrando preocupación por la seguridad y rapidez comercial de la IA. Posteriormente se disculpó por su participación.

- Nueva etapa (SSI): En 2024, abandonó OpenAI para fundar «Safe Superintelligence», una empresa enfocada en desarrollar una IA segura y avanzada, con el objetivo de no comercializar nada hasta lograr una superinteligencia segura.

Ilya Sutskever destaca no solo por su capacidad técnica, sino por su enfoque en la seguridad de la IA y su visión ética ante los riesgos que conlleva la inteligencia artificial general.

A día de hoy, febrero de 2026, Ilya Sutskever se encuentra liderando su propia compañía llamada Safe Superintelligence Inc. (SSI), de la cual es cofundador y actualmente CEO.

Tras su mediática salida de OpenAI en mayo de 2024, Sutskever se ha centrado exclusivamente en el desarrollo de una «superinteligencia segura», un proyecto que busca avanzar en las capacidades de la IA sin las distracciones de los ciclos comerciales de productos tradicionales.

🚀 Safe Superintelligence Inc. (SSI)

- Liderazgo: Sutskever asumió el cargo de CEO de la empresa tras la salida de Daniel Gross (quien se unió a Meta). Lidera la visión técnica y estratégica junto a un equipo de ingenieros e investigadores de élite en sus sedes de Palo Alto y Tel Aviv.

- Enfoque único: A diferencia de OpenAI o Google, SSI se define como un «laboratorio de tiro directo» (straight-shot lab). No lanzan aplicaciones ni herramientas de productividad; su único «producto» es la creación de una superinteligencia alineada con los valores humanos.

- Valoración: La empresa ha alcanzado una valoración de 32.000 millones de dólares, tras recibir inversiones masivas de firmas como Andreessen Horowitz (a16z) y Sequoia Capital, a pesar de no generar ingresos comerciales inmediatos.

🧠 Su visión actual (2026)

Sutskever ha estado advirtiendo recientemente sobre la «meseta de escalado». Según sus declaraciones a inicios de este año, cree que el simple hecho de añadir más datos y potencia de cálculo ya no es suficiente para mejorar la IA. Por ello, SSI está investigando:

- Nuevas arquitecturas: Buscando ir más allá de los modelos actuales hacia sistemas con mayor capacidad de razonamiento.

- Aprendizaje continuo: Modelos que puedan aprender de forma autónoma y constante, de manera similar a como lo hace un ser humano.

- Seguridad nuclear: Sutskever trata la seguridad de la IA no como una «función extra», sino como un desafío técnico fundamental que debe resolverse en el mismo núcleo del sistema.